Các vấn đề về lập chỉ mục có thể khiến nỗ lực SEO của bạn sẽ không mang lại hiệu quả, một trang có thể được tối ưu hóa tốt và có UX tuyệt vời, nhưng sẽ chẳng có giá trị gì nếu Google không nhìn thấy nó.

Các trang không được lập chỉ mục sẽ không có kết quả trên SERP và sẽ không mang lại lưu lượng truy cập và tạo ra chuyển đổi.

Ngược lại, nếu Google thỉnh thoảng nhìn thấy và lập chỉ mục một trang không được lập chỉ mục, thì bạn có nguy cơ bị rò rỉ thông tin cá nhân, bị Google phạt vì nội dung chất lượng thấp và các hậu quả khó đáp ứng khác.

Trong bài viết này, tôi sẽ chia sẻ những loại vấn đề lập chỉ mục thường gặp và cách khắc phục chúng cho website của bạn.

Nhưng trước tiên, hãy xem cách kiểm tra xem bạn có gặp bất kỳ vấn đề nào về lập chỉ mục trên website của mình hay không.

1. Làm thế nào để phát hiện các vấn đề về lập chỉ mục?

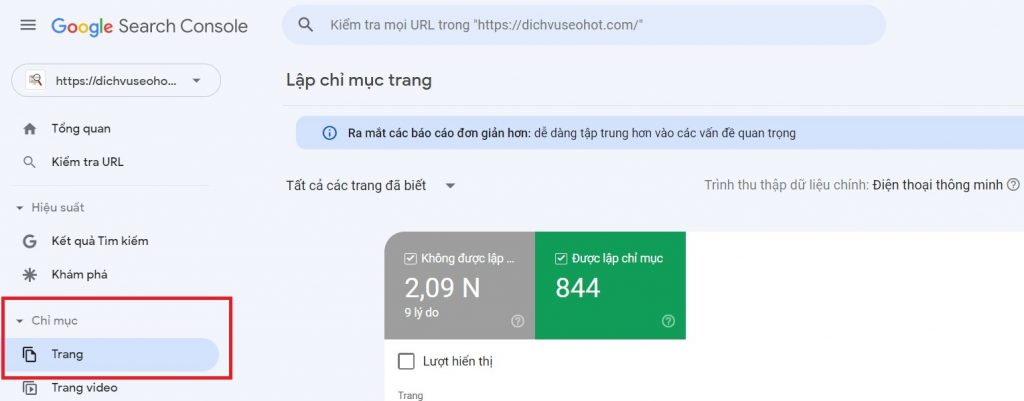

Google Search Console có thể cung cấp cho bạn hiểu biết cơ bản nhưng vẫn đầy đủ về các vấn đề lập chỉ mục mà trang web của bạn gặp phải. Tham khảo báo cáo Chỉ mục >> Trang để xem chúng.

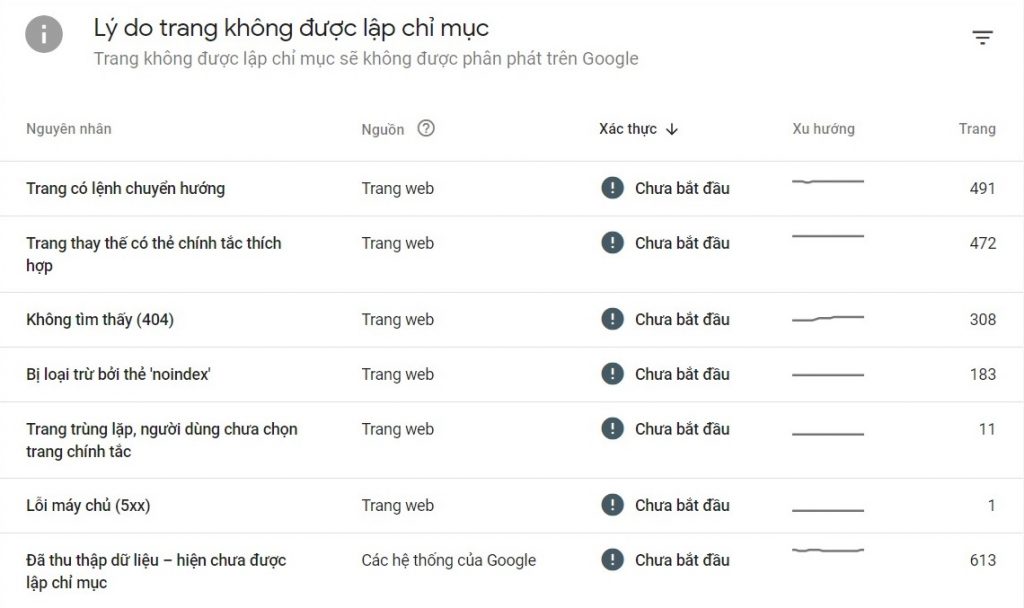

Các trang không được lập chỉ mục vì bất kỳ lý do gì đều được đặt dưới một phần, Lý do không được lập chỉ mục.

Bạn có thể tìm thấy các trang đã được lập chỉ mục nhưng vẫn có bất kỳ vấn đề cần khắc phục và cần sự chú ý của bạn ở cuối trang trong phần Cải thiện giao diện trang.

2. Không tìm thấy (404)

Lỗi không tìm thấy (404), hoặc một URL bị hỏng, có lẽ là một trong những sự cố lập chỉ mục phổ biến nhất. Một trang có thể có mã trạng thái 404 vì nhiều lý do. Giả sử, bạn đã xóa URL nhưng không xóa trang khỏi sơ đồ trang web, viết sai URL, v.v.

Như Google đã nói, bản thân các mã 404 không gây hại cho hiệu suất website của bạn cho đến khi đây là các URL được gửi (tức là những URL mà bạn đã yêu cầu Google lập chỉ mục một cách rõ ràng).

Nếu bạn thấy 404 URL trong báo cáo lập chỉ mục của mình, đây là các tùy chọn khả thi về cách sửa chúng nếu chúng không mong muốn xảy ra:

- Cập nhật sơ đồ trang web của bạn và kiểm tra xem URL bị ảnh hưởng có được viết chính xác hay không.

- Nếu trang đã chuyển đến một địa chỉ mới, hãy thiết lập chuyển hướng 301.

- Nếu trang bị xóa mà không có bất kỳ trang hay nội dung thay thế nào, thì hãy giữ nó là 404 nhưng xóa nó khỏi sơ đồ trang web. Bằng cách này, Google sẽ ngừng thu thập nó và tránh việc lãng phí ngân sách thu thập thông tin.

- Nếu bạn cần giữ lại 404, thì hãy thiết lập trang 404 tùy chỉnh thân thiện với người dùng – bạn có thể thêm một số liên kết hữu ích vào đó để khiến người dùng ở lại website của bạn thay vì tắt trang. Hãy nhớ rằng trang 404 vẫn là trang 404, vì vậy Google không nên lập chỉ mục nó cho dù nó có đẹp đến đâu.

Lưu ý rằng GSC không phân biệt 404 (không tìm thấy) với 410 (đã biến mất) và đặt chúng chung với nhau dưới dạng báo cáo lỗi 404. Đây từng là các loại mã phản hồi khác nhau: 404 có nghĩa là “không tìm thấy nhưng có thể tìm thấy sau“, trong khi 410 được sử dụng để đại diện cho “không tìm thấy và sẽ không ổn định“.

Ngày nay, Google cho biết họ xử lý cả 404 và 410 như nhau, vì vậy bạn có thể không cần phải bận tâm nếu bạn tìm thấy trang 410 trong báo cáo 404. Điều duy nhất tôi khuyên bạn nên làm là đặt trang 404 tùy chỉnh thay vì trang 410 trống để tiết kiệm lưu lượng truy cập và ngăn người dùng thoát khỏi website của bạn.

Nhiều SEO và chủ sở hữu web có thói quen chuyển hướng 404 đến trang chủ, nhưng sự thật là đó không phải là phương pháp hay nhất. Làm như vậy gây nhầm lẫn cho Google và dẫn đến các vấn đề Soft 404. Chúng ta hãy xem xét những lỗi Soft 404 mềm là gì.

3. Soft 404

Sự cố Soft 404 xảy ra khi một trang có phản hồi 200 OK nhưng Google không thể tìm thấy nội dung của trang đó và coi đó là 404. Soft 404 có thể xảy ra vì nhiều lý do và một số trong số đó có thể không phụ thuộc vào bạn, chẳng hạn như lỗi trong trình duyệt của người dùng.

Dưới đây là một số lý do khác:

- Một tệp bị thiếu ở phía máy chủ

- Một kết nối bị hỏng với cơ sở dữ liệu

- Trang kết quả tìm kiếm nội bộ trống

- Tệp JavaScript chưa tải hoặc bị thiếu

- Quá ít nội dung

- Che giấu trang

Cách fix: Những vấn đề này thực sự không khó để sửa chữa. Dưới đây là một số tình huống phổ biến:

- Nếu nội dung đã di chuyển và trang thực sự là 200 OK nhưng trống, thì hãy thiết lập chuyển hướng 301 đến địa chỉ mới;

- Nếu nội dung đã xóa không có nội dung thay thế, hãy đánh dấu nó là 404 và xóa nó khỏi sơ đồ trang web;

- Nếu trang đó là để tồn tại, thì hãy thêm một số nội dung và kiểm tra xem tất cả các tập lệnh trên đó có được hiển thị chính xác hay không (không bị chặn bởi robots.txt, được hỗ trợ bởi trình duyệt, v.v.);

- Nếu lỗi xảy ra do máy chủ không hoạt động khi Googlebot cố gắng tìm nạp trang, hãy kiểm tra xem máy chủ có hoạt động tốt hay không. Nếu đúng, hãy yêu cầu lập chỉ mục lại trang này.

4. Bị chặn do yêu cầu trái phép (401)

Lỗi 401 xảy ra khi Googlebot cố gắng truy cập trang yêu cầu ủy quyền và máy chủ của bạn chặn Googlebot làm như vậy.

Cách fix: Nếu bạn muốn trang đó được lập chỉ mục, hãy cấp cho Googlebot quyền liên quan hoặc xóa yêu cầu ủy quyền.

5. Bị chặn do bị cấm truy cập (403)

Loại lỗi này xảy ra khi tác nhân người dùng cung cấp thông tin đăng nhập để vào trang (đăng nhập, mật khẩu), nhưng không được cấp quyền truy cập để thực sự làm điều đó. Tuy nhiên, Googlebot không bao giờ cung cấp thông tin đăng nhập, vì vậy máy chủ trả về 403 thay vì trang dự định.

Nếu một trang bị chặn do nhầm lẫn và bạn thực sự cần nó được lập chỉ mục, hãy cho phép người dùng chưa đăng nhập truy cập hoặc cho phép rõ ràng Googlebot vào trang để đọc và lập chỉ mục nó.

6. URL đã gửi được đánh dấu là ‘noindex’

Như đã nói rõ từ tên, lỗi này xảy ra khi bạn yêu cầu Google lập chỉ mục một trang một cách rõ ràng (tức là thêm trang đó vào sơ đồ trang web hoặc yêu cầu lập chỉ mục theo cách thủ công), nhưng trang đó có được đánh dấu noindex trong thẻ robots.

Cách fix: Cách khắc phục khá đơn giản – xóa thẻ noindex để Google có thể truy cập trang.

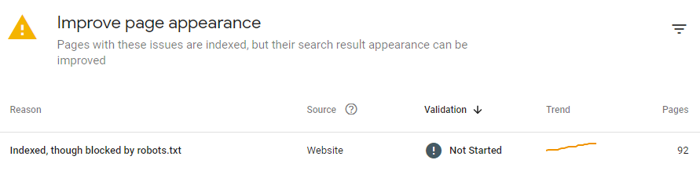

7. URL bị chặn bởi robots.txt

Nếu bạn chặn một trang với sự trợ giúp của robots.txt, thì Google sẽ không thu thập dữ liệu trang đó. Loại bỏ các hạn chế để có trang được lập chỉ mục.

Lưu ý: Có một số trường hợp, File Robots.txt không đảm bảo rằng trang sẽ không được lập chỉ mục. Đó là lý do tại sao đôi khi Google Search Console có thể hiển thị cho bạn những thứ như sau:

Các vấn đề như vậy có thể mang lại cho bạn nhiều vấn đề hơn so với các trang không được lập chỉ mục, vì Google có thể truy cập và tiết lộ thông tin không có ý định xuất hiện trong SERP (như giỏ hàng, dữ liệu cá nhân, v.v.).

Nếu bạn gặp vấn đề như vậy, hãy quyết định xem bạn có cần lập chỉ mục trang này hay không. Nếu vậy, hãy xóa URL khỏi tệp robots.txt. Nếu không, cũng xóa nó khỏi robots.txt nhưng áp dụng thẻ noindex hoặc giới hạn quyền truy cập cho người dùng không được ủy quyền. Sau khi áp dụng các hạn chế mới, bạn cũng có thể yêu cầu Google xóa trang khỏi chỉ mục thông qua GSC (Chỉ mục > Xóa URL > Gửi yêu cầu mới).

8. Được lập chỉ mục mà không có nội dung

Đây là một loại vấn đề khác có thể gây hại cho hiệu suất website của bạn kém hơn các trang không được lập chỉ mục. Google không ủng hộ các trang trống và rất có thể sẽ hạ thấp vị trí của bạn, vì các trang trống là dấu hiệu của các website spam và nội dung chất lượng thấp.

Nếu bạn nhận thấy rằng một số trang của mình có trạng thái Đã lập chỉ mục mà không có nội dung, hãy kiểm tra URL theo cách thủ công để tìm hiểu lý do. Ví dụ:

- Trang có thể có quá ít nội dung;

- Trang có thể có một số nội dung chặn hiển thị, nội dung này không tải đúng cách;

- Nội dung được che giấu.

Thực hiện các biện pháp tùy thuộc vào những gì bạn thấy.

Nếu bạn nghi ngờ có thể có một số nội dung chặn hiển thị trên trang bị ảnh hưởng, hãy kiểm tra cửa sổ bật lên sử dụng tập lệnh của bên thứ ba và đảm bảo rằng chúng hoạt động chính xác và Google thực sự có thể đọc được. Nhìn chung, Google sẽ thấy nội dung các trang của bạn giống như cách người dùng xem.

Nếu nội dung trang của bạn bị che giấu, hãy kiểm tra để đảm bảo rằng tất cả các tập lệnh hoặc hình ảnh đều có thể được truy cập bởi Google.

9. Lỗi chuyển hướng

Cộng đồng SEO đã nói rất nhiều về các vấn đề chuyển hướng URL. Tuy nhiên, các SEO vẫn tiếp tục mắc lỗi dẫn đến lỗi chuyển hướng và lập chỉ mục bị hỏng. Dưới đây là một số lý do phổ biến khiến Google không thể đọc chuyển hướng một cách chính xác:

- Chuỗi chuyển hướng quá dài

- Chuyển hướng dẫn đến một vòng lặp chuyển hướng vô tận (vòng lặp chuyển hướng)

- URL chuyển hướng vượt quá độ dài URL tối đa (2 MB đối với Google Chrome)

- Chuỗi chuyển hướng chứa URL không hợp lệ hoặc trống

Cách duy nhất để sửa lỗi chuyển hướng chỉ tóm lại một cụm từ: thiết lập chuyển hướng chính xác. Tránh các chuỗi chuyển hướng dài chỉ lãng phí ngân sách thu thập thông tin và làm cạn kiệt nguồn liên kết, đảm bảo không có URL 404 hoặc 410 trong chuỗi và luôn chuyển hướng URL đến các trang có liên quan.

10. Lỗi máy chủ (5xx)

Lỗi máy chủ có thể xảy ra vì máy chủ có thể đã gặp sự cố, hết thời gian chờ hoặc không hoạt động khi Googlebot xuất hiện.

Điều đầu tiên cần làm ở đây là kiểm tra URL bị ảnh hưởng. Đi tới công cụ Kiểm tra URL trong GSC và xem nó có còn hiển thị lỗi hay không. Nếu ổn, thì điều duy nhất bạn có thể làm là yêu cầu lập chỉ mục lại.

Nếu vẫn xảy ra lỗi, bạn có các tùy chọn sau tùy thuộc vào tính chất của lỗi:

- Giảm tải trang quá mức cho các yêu cầu trang động

- Đảm bảo rằng hosting website của bạn không bị sập, quá tải hoặc bị cấu hình sai

- Kiểm tra để đảm bảo rằng bạn không vô tình chặn Google

- Kiểm soát việc thu thập dữ liệu và lập chỉ mục website một cách khôn ngoan

Sau khi bạn đã khắc phục mọi thứ, hãy yêu cầu lập chỉ mục lại để Google tìm nạp trang nhanh hơn.

11. Sao chép mà không có trang chuẩn do người dùng chọn

Sao chép mà không có trang chuẩn do người dùng chọn là một vấn đề phổ biến đối với các website đa ngôn ngữ hoặc các trang thương mại điện tử có nhiều trang có nội dung giống hệt nhau hoặc gần giống nhau được thiết kế cho các mục đích khác nhau. Trong trường hợp này, bạn nên đánh dấu một trang là trang chuẩn để tránh các vấn đề về nội dung trùng lặp.

12. Trùng lặp, Google đã chọn trang chuẩn khác với người dùng

Đây là một điều thú vị. Có thể xảy ra trường hợp bạn đã chỉ định một trang nhất định là trang chuẩn, nhưng Google đã quyết định chọn một phiên bản khác của trang đó làm trang chuẩn để thay thế lập chỉ mục nó.

Cách dễ nhất để sửa những lỗi như vậy là đặt một thẻ chuẩn trên trang đã được Google chọn để không gây nhầm lẫn cho nó trong tương lai. Nếu bạn muốn giữ trang chuẩn trên trang mà bạn đã chọn, bạn có thể chuyển hướng trang do Google chọn đến URL bạn cần.

Lưu ý: Dưới đây tôi sẽ đề cập đến các vấn đề không yêu cầu bất kỳ hành động cụ thể nào (trong hầu hết các trường hợp). Tuy nhiên, chúng vẫn được hiển thị trong Google Search Console và tôi cho rằng bạn có thể thắc mắc ý nghĩa của chúng.

13. Trang thay thế có thẻ chuẩn phù hợp

Google không lập chỉ mục một trang vì nó trùng lặp với một trang chuẩn. Cứ để nguyên như vậy.

14. Đã khám phá – hiện chưa được lập chỉ mục

Nếu một trang có trạng thái Đã khám phá, thì Google đã phát hiện ra trang đó nhưng chưa thu thập dữ liệu và lập chỉ mục trang đó. Điều duy nhất bạn có thể làm ở đây là kiểm tra hướng dẫn lập chỉ mục của trang trong trường hợp có bất kỳ nghi ngờ nào. Nếu mọi việc đều ổn (tức là theo cách bạn muốn), thì hãy để Google làm phần còn lại sau.

14. Đã thu thập thông tin – hiện chưa được lập chỉ mục

Về mặt logic, mô tả này có nghĩa là Google đã thu thập dữ liệu trang của bạn nhưng chưa lập chỉ mục trang đó. Trang sẽ được lập chỉ mục nếu hướng dẫn lập chỉ mục không nêu điều ngược lại. Bạn không cần yêu cầu lập chỉ mục lại – Googlebot biết rằng trang đang đợi đến lượt được lập chỉ mục.

Kiểm tra kỹ các vấn đề lập chỉ mục không được Google phát hiện

15. Tóm lại

Thường xuyên kiểm tra cách các trang mục tiêu của bạn đã được lập chỉ mục chưa, vì lỗi có thể xảy ra bất cứ lúc nào. Và vì bất kỳ lý do gì: từ các vấn đề của nhà cung cấp dịch vụ hosting đến các lỗi của Google và các bản cập nhật của Google có thể ảnh hưởng đến cách các thuật toán của Google xử lý mọi thứ.